Analyse · Apple· Deutsch — auto

AirPods mit Kamera: Apples wahrer Meta-Killer, nicht Vision Pro

Bloomberg berichtet, dass AirPods mit Kamera die finale Testphase erreichen, gebremst nur durch das nächste Siri. Indem Apple KI-Vision in ein Gerät integriert, das Menschen tatsächlich tragen, wird es Metas KI-Brillen-Vorsprung von der Flanke angreifen.

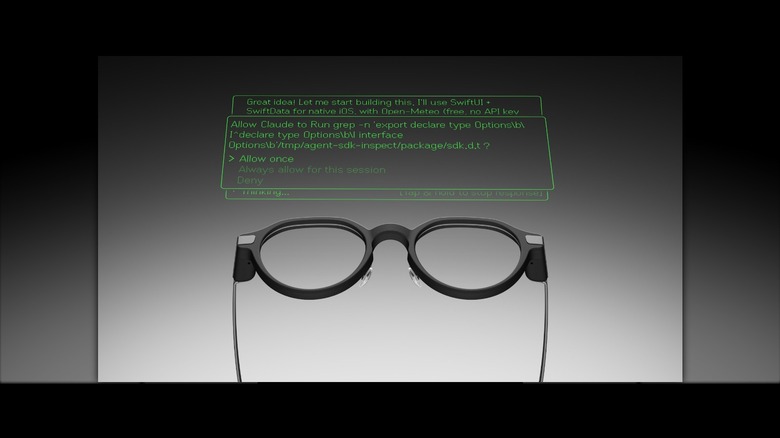

Illustration: Smart Glasses Daily

Vergessen Sie die Vision Pro. Während Analysten Apples Spatial-Computing-Mondmission fixieren, versteckt sich das wahre Trojanische Pferd des Unternehmens für Mainstream Augmented Reality offen: in Ihren Ohren. Laut Mark Gurman von Bloomberg befindet sich Apple in der finalen Testphase für AirPods, die mit niedrigauflösenden Kameras ausgestattet sind – ein Produkt, das nicht für Fotos, sondern für eine stets aktive, KI-gesteuerte Ansicht Ihrer Welt konzipiert ist. Die Hardware ist fast fertig; das einzige, was sie zurückhält, ist eine Siri, die intelligent genug ist, um zu verstehen, was sie sieht.

Dies ist nicht nur eine weitere Produktsortimentserweiterung. Dies ist ein den Markt neu definierender Überraschungsangriff. Während Meta jahrelang versucht hat, Menschen davon zu überzeugen, einen Computer ins Gesicht zu setzen, bereitet sich Apple darauf vor, Computervision in ein Gerät zu integrieren, das jährlich von rund 75 Millionen Menschen ohne Zögern gekauft wird. Die soziale Akzeptanz für Smart Glasses ist immer noch immens schwierig, aber für Earbuds? Sie ist null. Es ist keine Verhaltensänderung erforderlich.

Die Details des Leaks, zuerst von Frandroid gemeldet, zeichnen ein Bild klassischer Apple-Pragmatik. Das Design ist eine Weiterentwicklung der AirPods Pro, mit leicht verlängerten Stielen zur Unterbringung der Kameras und einer LED-Anzeige für den Datenschutz. Entscheidend ist, dass dies keine 12-Megapixel-Sensoren für Ihren Instagram-Feed sind; es sind niedrigauflösende Eingaben für 'Visual Intelligence', Apples Bezeichnung für seine multimodale KI. Es geht um kontextuelles Bewusstsein, nicht um Inhaltserstellung.

Rechnen wir mal nach, was Mark Zuckerberg den Schlaf rauben sollte. Meta feierte den Verkauf von rund zwei Millionen Ray-Ban Meta Brillen bis 2024, eine respektable Zahl für eine neue Kategorie. Apple hingegen liefert schätzungsweise 75 Millionen AirPods pro Jahr aus. Durch die Aufwertung eines Geräts, das bereits das Standardzubehör für seine zwei Milliarden aktiven iPhones ist, kann Apple innerhalb eines einzigen Produktzyklus eine Größenordnung von 'KI am Körper' erreichen, von der Meta nur träumen kann.

Dieser Unterschied in der Go-to-Market-Strategie ist entscheidend. Die Ray-Ban Meta verlangt, dass man ein neues Wearable mit neuen sozialen Regeln übernimmt. Die „AirPods Ultra“ – oder wie auch immer Apple sie nennen wird – werden einfach die besten AirPods sein, die man kaufen kann. Das Killer-Feature wird nicht die Kamera selbst sein, sondern die nahtlose Integration in ein Leben, das man bereits mit dem iPhone manage, vom Abfragen der Einkaufsliste durch einen Blick auf ein Produkt bis zum Einflüstern visueller Wegbeschreibungen ins Ohr.

Natürlich gibt es einen massiven Engpass: Siri. Apples angeschlagener Assistent ist der Knackpunkt, und das gemeldete Startfenster von 2027 unterstreicht die schiere Schwierigkeit der Aufgabe. Die Hardware ist ein gelöstes Problem, aber damit diese AirPods mehr als ein Gimmick sind, muss Apple Intelligence einen Quantensprung im Konversations- und Umgebungsverständnis liefern. Wenn die neue Siri einen Apfel nicht zuverlässig von einer Ampel unterscheiden kann, ist das gesamte Produkt von Anfang an zum Scheitern verurteilt.

Verglichen mit Meta AI ist Apples Ambition größer und weitaus integrierter. Metas aktueller Assistent auf den Ray-Bans ist ein cleverer Party-Trick, aber er fühlt sich oft wie ein Beta-Test an, der an eine Brille geschraubt wurde, mit spürbarer Latenz und einer Abhängigkeit von der Cloud. Apple baut für eine private, auf dem Gerät zuerst stattfindende Erfahrung, bei der die KI einen tiefen Kontext aus Ihrem Kalender, Nachrichten und Keychain hat – ein Graben, den Meta mit seinem angeschlagenen Ruf bezüglich des Datenschutzes einfach nicht überwinden kann.

Der Welleneffekt dieses Schrittes wird die gesamte Branche treffen. Samsung, das seit Jahren seine ‘Galaxy Glasses’ angedeutet hat, riskiert nun, flankiert zu werden, noch bevor es überhaupt in den Markt eintritt. Googles amorphe ‘Android XR’-Strategie, in Partnerschaft mit Qualcomm und anderen, basierte auf der Annahme, dass Brillen die nächste Grenze sind. Apple argumentiert effektiv, dass der nächste Formfaktor derjenige ist, der bereits existiert und nur auf ein Gehirn wartet.

Apples Wagnis ist jedoch nicht ohne erhebliche Risiken. Das primäre Gegenargument ist der Formfaktor selbst. Eine Ohrhörerkamera bietet eine „Kinn-Kamera“-Sicht auf die Welt – nach unten gerichtet, partiell und schräg. Wie nützlich ist diese Perspektive zur Identifizierung von Objekten, die Sie direkt betrachten? Dies ist eine grundlegende ergonomische und Computer-Vision-Herausforderung, für die Apple eine clevere Lösung finden muss.

Dann ist da die unvermeidliche Datenschutz-Gegenreaktion. Apple ist klug, sich auf niedrigauflösende, nicht teilbare Daten und eine Kontrollleuchte zu konzentrieren und direkt aus dem „Glasshole“-Debakel zu lernen. Aber eine Kamera ist eine Kamera, und die Optik eines Geräts, das Ihre Umgebung ständig „sehen“ kann, wird einen Feuersturm auslösen. Apples „Privacy-first“-Marketing wird wie nie zuvor auf die Probe gestellt.

Schließlich setzt Apple alles auf seine Fähigkeit, Siri zu reparieren, eine Assistentin, die seit einem Jahrzehnt Termine versäumt und unterperformt hat. Die Tatsache, dass ein physisches Produkt durch eine Software-Roadmap zurückgehalten wird, zeugt von der Herausforderung. Weitere Verzögerungen bei „Apple Intelligence“ verschieben die gesamte Wearable-AI-Vision in die ferne Zukunft und geben Rivalen ein wertvolles Zeitfenster zum Reagieren.

Was sollte Meta also jetzt tun? Panik wäre ein guter Anfang. Die kamera-zuerst, display-später-Strategie der Ray-Ban Meta steht nun vor einer existenziellen Bedrohung. Meta muss seine Roadmap für Project Hypernova, die Version mit einem Heads-up-Display, beschleunigen und auf den Markt bringen. Ein Display, selbst ein einfaches, schafft einen Feature-Graben und bietet visuelles Feedback, das ein reines Audiogerät nicht bieten kann. Metas kurzer, unangefochtener Vorsprung bei KI-Wearables steht kurz vor dem Ende, und seine einzige Hoffnung ist, Apple zu überholen, indem es ein echtes AR-Gerät baut, bevor Apple den KI-Hörgerät-Standard setzt.

Diesen Artikel teilen