Analyse · —· Deutsch — auto

Smart Glasses 2026: Immer noch eine Lösung für das falsche Problem

Technologiegiganten setzen voll auf KI-Assistenten und dezente Formfaktoren, übersehen jedoch weiterhin den Kernnutzen für alltägliche Anwender. Der Bildschirm, oder dessen Fehlen, bleibt das grundlegende Missverständnis, das die Marktstagnation antreibt.

Konzeptkunst einer Person, die eine schlanke, futuristische Smart Glass trägt, mit dezenten, durchscheinenden UI-Elementen, die vor ihren Augen sichtbar sind, während sie mit der realen Welt interagiert.

Die Smart-Glass-Erzählung ist eine sich wiederholende, kaputte Schallplatte. Trotz Behauptungen, die Debatte um Gesichtskomputer sei „vorbei“ – eine Aussage, die oft den Erfolg der Ray-Ban von Meta als Beweis anführt – bleibt das grundlegende Produkt falsch auf echte Benutzerbedürfnisse abgestimmt. Jeder beeilt sich, einen KI-Co-Piloten in einen schlanken Rahmen zu zwängen, aber nur wenige überlegen ernsthaft, *was* diese KI tun sollte oder *wie* sie Informationen präsentieren sollte, die das tägliche Leben über ein Gimmick hinaus wirklich bereichern.

Diese Besessenheit von KI-first- und screen-last- — oder sogar screen-less-Ansätzen ist besonders verwirrend. Apple, das Berichten zufolge einen Start Ende 2026 vorbereitet, konzentriert sich stark auf KI-gesteuerte Funktionen und die iPhone-Integration und umgeht bewusst ein „vollständiges Augmented Reality-Erlebnis“. Auch Huawei mischt sich mit HarmonyOS-betriebenen Brillen ein, die Echtzeitübersetzungen und proprietäre KI betonen. Dies sind hochentwickelte Audio-Wearables mit Kameras, keine echten Smart Glasses.

Ray-Ban Meta bietet trotz seines unbestreitbaren Erfolgs bei der Normalisierung von Gesichtscomputern und der Integration von Sehstärken mit Modellen wie dem Blayzer und Scriber Optics grundsätzlich ein screen-less Erlebnis. Sie haben die Aspekte „Tragbarkeit“ und „Stil“ gemeistert und bewiesen, dass Menschen Technologie *auf ihr Gesicht* setzen werden, wenn sie gut aussieht. Aber der eigentliche „smarte“ Teil – die visuelle Erweiterung, die die Kategorie definiert – fehlt und ist einem akustischen Hinweis oder einem aufgenommenen Bild überlassen.

Dieses Versäumnis ist nicht nur eine semantische Spitzfindigkeit; es ist ein strategischer Fehler. Wie „The Silent Screen War“ betonte, ist eine Smart Glass ohne eine persistente, immersive visuelle Ebene keine Smart Glass. Es ist ein Audiogerät mit Kamera. Während sich alle darüber den Kopf zerbrechen, ob ihre Rahmen ein LLM ausführen oder Siri integrieren können, wird das wahre Schlachtfeld für den Nutzen, der verdammte Bildschirm, von den prominentesten Akteuren ignoriert.

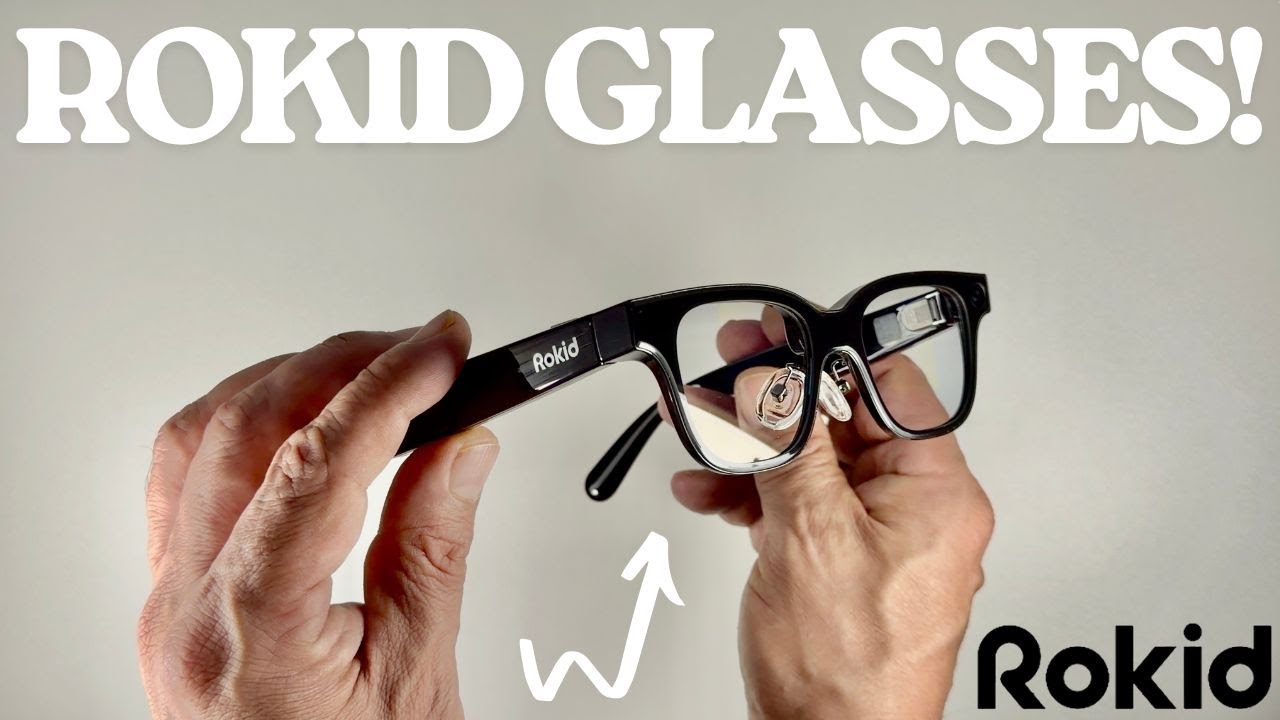

Währenddessen dominieren Unternehmen wie XREAL, Rokid und RayNeo still und leise den einen Faktor, der für die AR-Adoption wirklich entscheidend ist: das Display. Insbesondere Rokid hat einen überraschenden Erfolg erzielt und Berichten zufolge Meta bei den Verkaufszahlen übertroffen, indem es leistungsstarke, leichte KI-Brillen *mit* integrierten Displays und einem offenen Ökosystem anbietet, das mehrere KI-Assistenten unterstützt. Sie verstehen, dass KI ein Feature ist, nicht das gesamte Produkt.

Vitures „Beast“ XR Glasses unterstreichen diesen Punkt zusätzlich und bieten IMAX-große Visuals für unterwegs mit Sonys Micro-OLED-Panels. Diese Geräte priorisieren das *visuelle* Erlebnis und liefern immersive Inhalte auf großem Bildschirm direkt in die Augen des Benutzers. Dies betrifft nicht nur die Unterhaltung; es geht darum, Informationen auf eine Weise wahrnehmbar zu machen, die KI-first-, screen-less-Geräte nicht können.

Der Markt scheint zweigeteilt: Einerseits verkaufen sich stilvolle Kamera- und Mikrofonrahmen wie Ray-Ban Meta gut, weil sie die soziale Akzeptanz und grundlegende Foto-/Audioaufnahme ermöglichen. Andererseits beweist eine stille Rebellion von echten AR-Brillen, wie denen von Rokid und Viture, dass Benutzer reagieren, wenn man ein überzeugendes visuelles Erlebnis liefert.

Die hartnäckige Aussage der Technologiegiganten deutet darauf hin, dass die Zukunft einen „immer aktiven KI-Assistenten, der auf Ihrem Gesicht lebt und Ihre Realität vermittelt“, bedeutet. Aber welche Realität vermitteln wir, wenn sie rein auditiv ist? Wie werden entscheidende, kontextabhängige Erkenntnisse ohne eine sichtbare Schnittstelle geliefert?

Man denke an das Potenzial für Echtzeitübersetzungen oder Informationsüberlagerungen. Huawei verspricht Echtzeitübersetzungen, aber wie wird das ohne eine sinnvolle visuelle Komponente geliefert? Eine Stimme im Ohr, die sagt: „Sie sagten, ‚Hallo‘“, ist weniger wirkungsvoll, als „Hola“ mit einer Übersetzungsüberlagerung auf einem fremden Schild zu sehen.

Der Fokus auf Computerleistungsdaten und KI-Funktionalität ist wichtig, birgt jedoch das Risiko, hochentwickelte Gehirne ohne ein sensorisches Nervensystem zu bauen, das den Formfaktor „Brille“ wirklich nutzt. Wir bekommen immer leistungsfähigere „Geister in der Maschine“, aber keine überzeugende visuelle Manifestation ihrer Intelligenz in unserem Sichtfeld.

Auch wenn Snap Berichten zufolge einem Verbraucherstart für seine 3-Milliarden-Dollar-AR-Brillenwette nahe ist, bleibt die Kernfrage: Welches visuelle Erlebnis werden sie liefern? Wenn es lediglich ein weiteres Kamera- und Audiogerät ist, dann ist es eine weitere verpasste Gelegenheit, die visuelle Wahrnehmung der Welt des Benutzers wirklich zu erweitern.

Die „ICE Glasses“ des Heimatschutzministeriums, die darauf abzielen, Personen in Echtzeit mithilfe biometrischer Daten über ein Head-up-Display zu identifizieren, zeigen ironischerweise, was Unternehmenskunden verlangen: umsetzbare, situative visuelle Informationen. Auch alltägliche Nutzer, vielleicht weniger zur Überwachung und mehr zum Nutzen, suchen nach diesem direkten visuellen Feedback, nicht nur nach Umgebungs-KI-Rauschen.

Solange die Apples und Metas dieser Welt die visuelle Erweiterung nicht priorisieren – ein persistentes, integriertes Display, das digitale Informationen nahtlos mit der realen Welt verbindet – werden sie weiterhin falsch interpretieren, was alltägliche Benutzer wirklich von Smart Glasses erwarten. Der Bildschirm ist kein sekundäres Merkmal; er ist das bestimmende Element.

Das Rennen um den „immer aktiven KI-Assistenten“ ist ein lohnendes Unterfangen, aber es ist fundamental vom Formfaktor abgekoppelt, wenn es sich nicht visuell manifestiert. 2026, so scheint es, wird immer noch ein Jahr sein, in dem Smart Glasses die Sache weitgehend falsch anpacken und einen auditiven Geist mit einer wirklich Augmented Reality verwechseln.

Diesen Artikel teilen