Analyses · Apple· Français — auto

Des AirPods avec caméras : le vrai "tueur de Meta" d'Apple, pas le Vision Pro

Bloomberg rapporte que des AirPods équipés de caméras sont en phase de test finale, uniquement dépendants de la prochaine génération de Siri. En intégrant la vision IA dans un appareil que les gens portent déjà, Apple est sur le point de détrôner Meta dans les lunettes IA par surprise.

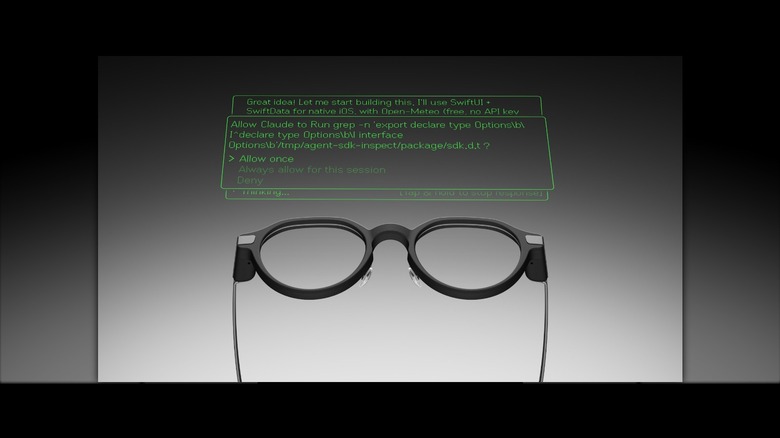

Illustration: Smart Glasses Daily

Oubliez le Vision Pro. Tandis que les experts se focalisent sur le projet fou de l'informatique spatiale d'Apple, le véritable cheval de Troie de l'entreprise pour la réalité augmentée grand public se cache à la vue de tous : vos oreilles. Selon Mark Gurman de Bloomberg, Apple est dans les dernières phases de test d'AirPods équipés de caméras basse résolution, un produit conçu non pas pour la photographie, mais pour une vue permanente, pilotée par l'IA, de votre monde. Le matériel est presque prêt ; la seule chose qui le retient est un Siri suffisamment intelligent pour comprendre ce qu'il voit.

Il ne s'agit pas d'une simple extension de gamme de produits. C'est une embuscade qui redéfinit une catégorie. Alors que Meta a passé des années à essayer de convaincre les gens de mettre un ordinateur sur leur visage, Apple s'apprête à intégrer la vision par ordinateur dans un appareil que 75 millions de personnes achètent déjà chaque année sans y penser à deux fois. Le frottement social pour les lunettes connectées reste immense, mais pour les écouteurs ? Il est nul. Aucun changement de comportement n'est requis.

Les détails de la fuite, rapportés pour la première fois par Frandroid, dépeignent un classicisme pragmatique à la Apple. Le design est une itération des AirPods Pro, avec des tiges légèrement allongées pour loger les caméras et un voyant LED pour la confidentialité. Surtout, ce ne sont pas des capteurs de 12 mégapixels pour votre fil Instagram ; ce sont des entrées basse résolution pour la "Visual Intelligence", le nom donné par Apple à son IA multimodale. Il s'agit de conscience contextuelle, pas de création de contenu.

Faisons le calcul qui devrait empêcher Mark Zuckerberg de dormir la nuit. Meta a célébré la vente d'environ deux millions de lunettes Ray-Ban Meta jusqu'en 2024, un nombre respectable pour une nouvelle catégorie. Apple, cependant, livre environ 75 millions d'AirPods par an. En améliorant un appareil qui est déjà l'accessoire par défaut de ses deux milliards d'iPhone actifs, Apple peut atteindre une échelle d'"IA sur le corps" en un seul cycle de produit dont Meta ne peut que rêver.

Cette différence dans la stratégie de mise sur le marché est primordiale. Les Ray-Ban Meta vous demandent d'adopter un nouveau vêtement connecté avec de nouvelles règles sociales. Les "AirPods Ultra" — ou quel que soit le nom qu'Apple leur donnera — seront simplement les meilleurs AirPods que vous puissiez acheter. La fonctionnalité clé ne sera pas la caméra elle-même, mais l'intégration transparente avec une vie que vous gérez déjà sur votre iPhone, de la vérification de votre liste de courses en regardant un produit à l'obtention d'indications visuelles de marche murmurées à votre oreille.

Bien sûr, il y a un obstacle majeur : Siri. L'assistant malmené d'Apple est le maillon faible, et la fenêtre de lancement rapportée en 2027 souligne l'énorme difficulté de la tâche. Le matériel est un problème résolu, mais pour que ces AirPods soient plus qu'un gadget, Apple Intelligence doit faire un bond quantique dans la compréhension conversationnelle et environnementale. Si le nouveau Siri ne peut pas distinguer de manière fiable une tomate d'un feu de signalisation, tout le produit est mort-né.

Comparé à Meta AI, l'ambition d'Apple est plus grande et bien plus intégrée. L'assistant actuel de Meta sur les Ray-Bans est un tour de passe-passe astucieux, mais il donne souvent l'impression d'être une version bêta boulonnée sur une paire de lunettes, avec une latence notable et une dépendance au cloud. Apple construit pour une expérience privée, d'abord sur l'appareil, où l'IA a un contexte profond provenant de votre calendrier, de vos messages et de votre Trousseau, un avantage que Meta, avec sa réputation de confidentialité ternie, ne peut tout simplement pas franchir.

L'effet d'entraînement de ce mouvement frappera toute l'industrie. Samsung, qui taquine ses "Galaxy Glasses" depuis des années, risque maintenant d'être débordé avant même d'entrer sur le marché. La stratégie amorphe "Android XR" de Google, en partenariat avec Qualcomm et d'autres, a été basée sur l'hypothèse que les lunettes sont la prochaine frontière. Apple soutient en fait que le prochain facteur de forme est celui qui est déjà là, attendant juste un cerveau.

Cependant, le pari d'Apple n'est pas sans risque significatif. Le principal contre-argument est le facteur de forme lui-même. Une caméra d'écouteur offre une vue du monde de type "caméra de menton" — vers le bas, partielle et oblique. Quelle est l'utilité de cette perspective pour identifier des objets que vous regardez directement ? C'est un défi fondamental d'ergonomie et de vision par ordinateur pour lequel Apple doit avoir une solution astucieuse.

Ensuite, il y a la réaction inévitable en matière de confidentialité. Apple est intelligent de se concentrer sur des données basse résolution, non partageables, et un voyant lumineux, tirant directement les leçons de la débâcle des 'Glasshole'. Mais une caméra est une caméra, et l'optique d'un appareil qui peut perpétuellement 'voir' votre environnement déclenchera une tempête. Le marketing axé sur la confidentialité d'Apple sera mis à l'épreuve comme jamais auparavant.

Enfin, Apple mise gros sur sa capacité à réparer Siri, un assistant qui a manqué des délais et n'a pas tenu ses promesses pendant une décennie. Le fait qu'un produit physique soit retenu par une feuille de route logicielle témoigne de la difficulté. Tout nouveau retard d'"Apple Intelligence" repousse l'ensemble de la vision de l'IA portable dans un avenir lointain, donnant aux rivaux une précieuse opportunité de réagir.

Alors, que devrait faire Meta en ce moment ? La panique serait un bon début. La stratégie "caméra d'abord, affichage ensuite" des Ray-Ban Meta fait face à une menace existentielle. Meta doit accélérer sa feuille de route pour Project Hypernova, la version avec un affichage tête haute, et la commercialiser. Un affichage, même simple, crée un avantage concurrentiel, offrant un retour visuel qu'un appareil uniquement audio ne peut égaler. L'avance brève et incontestée de Meta dans les objets connectés IA est sur le point de se terminer, et son seul espoir est de devancer Apple en construisant un véritable appareil AR avant qu'Apple ne normalise l'audible IA.

Partager cet article