Análisis · Apple· Español — auto

AirPods con cámara: el verdadero “Meta-Killer” de Apple, no Vision Pro

Bloomberg informa que los AirPods equipados con cámaras están en fase final de prueba, condicionados únicamente por la próxima generación de Siri. Al integrar la visión de IA en un dispositivo que la gente realmente usa, Apple está a punto de detonar el liderazgo de Meta en gafas con IA desde el flanco.

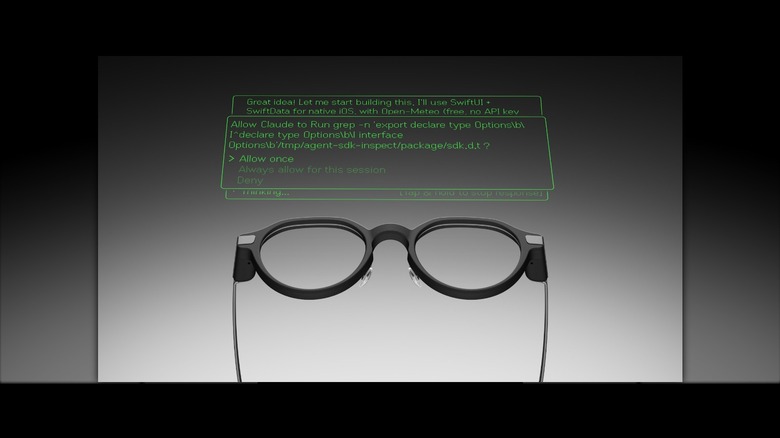

Illustration: Smart Glasses Daily

Olvídate del Vision Pro. Mientras los expertos se centran en el ambicioso proyecto de "computación espacial" de Apple, el verdadero caballo de Troya de la compañía para la realidad aumentada masiva se esconde a plena vista: tus oídos. Según Mark Gurman de Bloomberg, Apple está en las etapas finales de prueba de AirPods equipados con cámaras de baja resolución, un producto diseñado no para fotos, sino para una visión "siempre activa" y con IA de tu mundo. El hardware está casi listo; lo único que lo frena es una Siri lo suficientemente inteligente como para entender lo que está viendo.

Esto no es solo una extensión más de la línea de productos. Es una emboscada que definirá la categoría. Mientras Meta ha pasado años intentando convencer a la gente de que se ponga una computadora en la cara, Apple se prepara para introducir la visión artificial en un dispositivo que aproximadamente 75 millones de personas ya compran anualmente sin pensarlo dos veces. La fricción social para las gafas inteligentes sigue siendo inmensa, pero ¿para los auriculares? Es nula. No se requiere ningún cambio de comportamiento.

Los detalles de la filtración, reportados por primera vez por Frandroid, pintan un cuadro del pragmatismo clásico de Apple. El diseño es una iteración de los AirPods Pro, con vástagos ligeramente alargados para albergar las cámaras y una luz indicadora LED para la privacidad. Crucialmente, no se trata de sensores de 12 megapíxeles para tu feed de Instagram; son entradas de baja resolución para ‘Visual Intelligence’, el nombre de Apple para su IA multimodal. Se trata de conciencia contextual, no de creación de contenido.

Hagamos las cuentas que deberían quitarle el sueño a Mark Zuckerberg. Meta celebró la venta de alrededor de dos millones de gafas Ray-Ban Meta hasta 2024, un número respetable para una nueva categoría. Apple, sin embargo, envía un estimado de 75 millones de AirPods al año. Al actualizar un dispositivo que ya es el accesorio predeterminado para sus dos mil millones de iPhones activos, Apple puede alcanzar una escala de 'IA en tu cuerpo' en un solo ciclo de producto que Meta solo puede soñar.

Esta diferencia en la estrategia de salida al mercado lo es todo. Las Ray-Ban Meta te piden que adoptes un nuevo wearable con nuevas reglas sociales. Los 'AirPods Ultra' —o como los llame Apple— serán simplemente los mejores AirPods que puedas comprar. La característica clave no será la cámara en sí, sino la integración perfecta con una vida que ya gestionas en tu iPhone, desde consultar tu lista de compras echando un vistazo a un producto hasta obtener indicaciones visuales para caminar susurradas en tu oído.

Por supuesto, hay un cuello de botella masivo: Siri. La maltrecha asistente de Apple es el palo más largo en la tienda, y la ventana de lanzamiento rumoreada para 2027 subraya la enorme dificultad de la tarea. El hardware es un problema resuelto, pero para que estos AirPods sean algo más que un truco, Apple Intelligence necesita lograr un salto cuántico en la comprensión conversacional y ambiental. Si la nueva Siri no puede distinguir de forma fiable un tomate de un semáforo, todo el producto estará condenado al fracaso.

Comparada con Meta AI, la ambición de Apple es más grande y mucho más integrada. El asistente actual de Meta en las Ray-Ban es un truco de fiesta ingenioso, pero a menudo se siente como una prueba beta atornillada a un par de gafas, con latencia notable y una dependencia de la nube. Apple está construyendo una experiencia privada, primero en el dispositivo, donde la IA tiene un contexto profundo de tu calendario, mensajes y Keychain, un foso que Meta, con su empañada reputación de privacidad, simplemente no puede cruzar.

El efecto dominó de este movimiento golpeará a toda la industria. Samsung, que lleva años adelantando sus 'Galaxy Glasses', ahora corre el riesgo de ser flanqueada antes incluso de entrar en el mercado. La estrategia amorfa de Google de 'Android XR', en colaboración con Qualcomm y otros, se ha basado en la suposición de que las gafas son la próxima frontera. Apple está argumentando de manera efectiva que el próximo factor de forma es el que ya está aquí, solo esperando un cerebro.

Sin embargo, la jugada de Apple no está exenta de riesgos significativos. El principal contraargumento es el propio factor de forma. Una cámara de auricular ofrece una vista del mundo tipo 'cámara de barbilla': hacia abajo, parcial y oblicua. ¿Qué tan útil es esa perspectiva para identificar objetos que estás mirando directamente? Este es un desafío fundamental de ergonomía y visión artificial para el que Apple debe tener una solución inteligente.

Luego está la inevitable reacción negativa en materia de privacidad. Apple es inteligente al centrarse en datos de baja resolución, no compartibles, y en una luz indicadora, aprendiendo directamente del desastre de los 'Glasshole'. Pero una cámara es una cámara, y la óptica de un dispositivo que puede 'ver' perpetuamente tu entorno desatará una tormenta. El marketing de Apple de 'la privacidad ante todo' será puesto a prueba como nunca antes.

Finalmente, Apple está apostando la granja a su capacidad para arreglar a Siri, una asistente que ha estado incumpliendo plazos y ofreciendo menos de lo esperado durante una década. El hecho de que un producto físico esté siendo frenado por una hoja de ruta de software es un testimonio del desafío. Cualquier retraso adicional en 'Apple Intelligence' empuja toda la visión de IA portátil hacia un futuro lejano, dando a los rivales una preciosa ventana para reaccionar.

Entonces, ¿qué debería estar haciendo Meta ahora mismo? Entrar en pánico sería un buen comienzo. La estrategia de las Ray-Ban Meta de "cámara primero, pantalla después" se enfrenta ahora a una amenaza existencial. Meta debe acelerar su hoja de ruta para Project Hypernova, la versión con una pantalla de visualización frontal, y lanzarla al mercado. Una pantalla, incluso una simple, crea un foso de características, ofreciendo una retroalimentación visual que un dispositivo solo de audio no puede igualar. El breve e indiscutible liderazgo de Meta en wearables con IA está a punto de terminar, y su única esperanza es superar a Apple construyendo un verdadero dispositivo AR antes de que Apple normalice el dispositivo de escucha con IA.

Compartir